Last Updated on 04/04/2026 by Anisa

Përplasja mes qeverisë amerikane dhe Anthropic thellon një prirje shqetësuese, shkruan The Economist

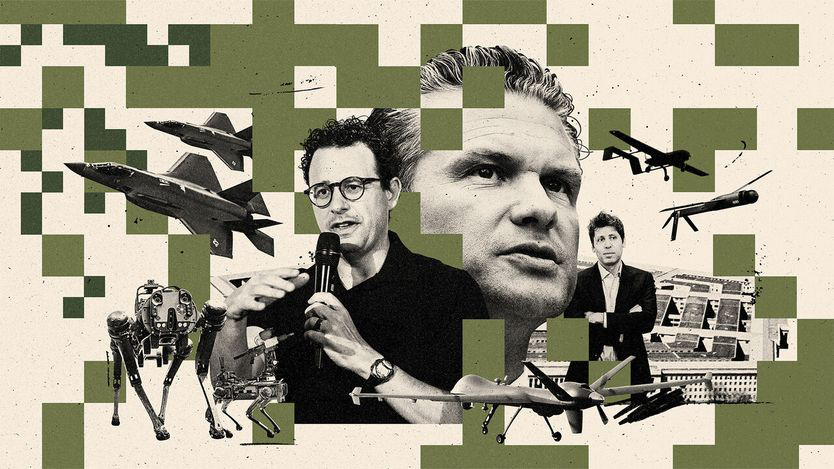

Edhe pse po përpiqej të tingëllonte vendimtar, Donald Trump pa dashje përcolli diçka nga ambivalenca e botës për zhvillimin e shpejtë të Inteligjencës Artificiale (IA). Më 27 shkurt, presidenti amerikan sulmoi ashpër “të çmendurit e së majtës” të Anthropic, një laborator amerikan i IA që punon, ndër të tjera, me departamentin e mbrojtjes dhe agjenci të tjera qeveritare.

“Po urdhëroj ÇDO agjenci federale në qeverinë e Shteteve të Bashkuara të NDËRPRESË MENJËHERË çdo përdorim të teknologjisë së Anthropic. Nuk na duhet, nuk e duam dhe nuk do të bëjmë më biznes me ta!” shpërtheu ai në rrjetet sociale.

Megjithatë, vetëm një fjali më pas, ai premtoi gjithashtu se do të përdorte “të gjithë fuqinë e presidencës” për ta detyruar Anthropic të bashkëpunonte me qeverinë për gjashtë muajt e ardhshëm. Me sa duket, “të çmendurit” përbëjnë njëkohësisht një rrezik të papranueshëm për funksionimin e shtetit dhe janë aq të domosdoshëm për të sa duhet të detyrohen të punojnë me të, nëse është e nevojshme.

Që kur është bërë e qartë se IA mund të tejkalojë aftësitë njerëzore, bota është përballur me variante të këtij dileme: teknologjia duket njëkohësisht shumë e fuqishme për t’u injoruar dhe shumë e rrezikshme për t’u përqafuar pa rezerva.

Në fakt, përplasja mes Anthropic dhe Trump u nxit nga shqetësimet e vetë kompanisë se modelet e saj mund të përdoren për qëllime dashakeqe. Trump dhe bashkëpunëtorët e tij, në të kundërt, dëshironin të vazhdonin përdorimin e tyre me sa më pak kufizime.

Ironia e frikshme është se qeveria amerikane ka vendosur të ecë përpara pikërisht në momentin kur fuqia e IA për të shkaktuar dëme të rënda në botën reale, jo vetëm në skenarë hipotetikë, po bëhet shumë më e qartë.

Zemërimi i Trump ndaj Anthropic buron nga një urdhër që ai lëshoi vitin e kaluar “për të ruajtur dhe për të forcuar dominimin global të Amerikës në IA”. Kjo e shtyu Pete Hegseth, sekretarin e Mbrojtjes, të urdhërojë “eksperimentimin me modelet kryesore amerikane të IA” në të gjithë forcat e armatosura në fillim të këtij viti.

Ai dëshiron ta përshpejtojë procesin sa më shumë të jetë e mundur dhe madje publikoi një poster rekrutimi ku shfaqet në pozën e Uncle Sam, duke iu drejtuar ushtarëve: “Dua që ju të përdorni IA.” Vitin e kaluar zëvendëspresidenti J.D. Vance e hodhi poshtë sigurinë e IA-së si një obsesion liberal të gabuar.

Valle sigurie

Pavarësisht nxitimit të dukshëm të administratës (ose ndoshta pikërisht për shkak të tij), Anthropic luftoi për të ruajtur garancitë ligjore që do të parandalonin përdorimin e modeleve të saj për mbikëqyrje masive brenda vendit ose për armë plotësisht autonome.

Departamenti i Mbrojtjes këmbënguli se duhet të lejohet të përdorë IA në çdo mënyrë që e konsideron ligjore dhe akuzoi Anthropic për “një akt frikacak të sinjalizimit moral korporativ” kur ajo refuzoi të tërhiqej.

Hegseth tha se do ta shpallte kompaninë “rrezik për sigurinë kombëtare në zinxhirin e furnizimit”, një klasifikim që deri tani është përdorur për kompani të huaja, produktet e të cilave mund të shfrytëzohen për spiunazh ose sabotim. “Asnjë kontraktor, furnizues apo partner që bën biznes me ushtrinë e Shteteve të Bashkuara nuk mund të zhvillojë aktivitet tregtar me Anthropic”, deklaroi ai.

Kërcënimi ndaj Anthropic është i rëndë. Kontrata e diskutueshme me Pentagonin vlen 200 milionë dollarë, një shumë e vogël për një kompani që së fundmi është vlerësuar me 380 miliardë dollarë. Por Anthropic ka gjithashtu kontrata me agjenci të tjera qeveritare, të cilat tani janë në rrezik.

Nëse çdo kompani që bashkëpunon me departamentin e mbrojtjes detyrohet vërtet të ndërpresë lidhjet, kjo do të prekë jo vetëm shumë klientë të tjerë, por edhe furnizues dhe investitorë. Anthropic argumenton se Hegseth nuk ka autoritetin të urdhërojë një izolim të tillë dhe mund të ndalojë vetëm përdorimin e Claude për të përmbushur kontratat ushtarake.

Më 4 mars, The Economist u ftua në zyrat e Anthropic për të biseduar me Dario Amodei për emisionin tonë javor “Insider”. Kompania dukej optimiste për arritjen e një marrëveshjeje me Pentagonin.

Por pak para se të fillonte biseda, një memorandum i brendshëm i shpërndarë në media prishi planet. Në memorandum, Amodei ia atribuonte përplasjen faktit se nuk i kishte bërë Trump “lavdërime në stil diktatori” dhe stafi u informua se Departamenti i Mbrojtjes kishte përhapur “gënjeshtra të pastra”. Themeluesit e Anthropic u mblodhën në një sallë mbledhjesh për të menaxhuar situatën, dhe kur The Economist po shkonte për botim, intervista ende nuk kishte ndodhur.

Përplasja nuk është e mirë as për qeverinë amerikane. Të paktën në afat të shkurtër, Anthropic është e domosdoshme. Modeli i saj i madh gjuhësor, Claude, është jashtëzakonisht i mirë në shkrimin e kodeve kompjuterike. Për më tepër, Anthropic ishte i vetmi laborator IA modelet e të cilit ishin miratuar për përdorim mbi të dhëna ushtarake të klasifikuara deri në fund të shkurtit, kur Pentagoni i dha një autorizim të ngjashëm rivalit të tij xAI.

Modeli gjuhësor i xAI, Grok, konsiderohet gjerësisht më i pasigurt dhe më pak i besueshëm. Edhe pse OpenAI, një rival tjetër, nënshkroi një kontratë me Pentagonin po atë ditë kur Trump dhe Hegseth u kthyen kundër Anthropic, kompanisë do t’i duhet ende kohë për t’u integruar në sistemet ushtarake. Më keq akoma, kjo polemikë ka gjasa të dekurajojë disa kompani të IA që madje të aplikojnë për kontrata qeveritare.

Pse të përfshihesh me një partner që mund të shkatërrojë biznesin tënd nëse zemërohet? Dhe nëse qëllimi kryesor i administratës është të ruajë dhe të zgjerojë epërsinë e Amerikës në IA, përpjekja për të shtypur një nga kompanitë më të suksesshme të IA në vend duket qartazi kundërproduktive.

Të dyja palët mund të jenë duke bërë disi teatër. Zemërimi i qeverisë duket se buron më pak nga një dëshirë e thellë për të përdorur mjetet e Anthropic për qëllimet e diskutueshme dhe më shumë nga indinjata e thjeshtë për t’u përballur me një “Jo”.

Ndryshe nga Partia Komuniste Kineze, e cila mund të marrë në kontroll çdo produkt të industrisë kineze të IA sipas dëshirës dhe për çdo qëllim, autoritetet amerikane duhet të përballen me kufizimet e ligjit, për të mos përmendur egot e drejtuesve të teknologjisë. Sam Altman, drejtuesi i OpenAI, thotë se edhe kompania e tij nuk do të përfshihej kurrë në mbikëqyrje masive brenda vendit apo në armë plotësisht autonome.

Por ai këmbëngul se modelet e OpenAI kanë mekanizma sigurie që parandalojnë përdorime të tilla, duke e bërë të panevojshme çdo garanci ligjore shtesë. Në memorandum, Amodei rezervoi kritikat më të ashpra për Altman, mesazhet e të cilit i quajti “mashtruese”, mekanizmat teknikë të sigurisë “teatër sigurie” dhe punonjësit e tij “një tufë naive”.

Strehë e sigurt

Nga ana e saj, Anthropic me gjasë ishte e shqetësuar për më shumë sesa dy përdorime hipotetike të IA-së së saj. Në një industri të njohur për deklarata të mëdha për të bërë mirë, Anthropic bie në sy për retorikën e saj idealiste.

Ajo u themelua nga një grup punonjësish të OpenAI që shqetësoheshin se kompania e tyre nuk po i qëndronte mjaftueshëm besnike misionit të deklaruar për të zhvilluar IA të avancuar në mënyrë të sigurt dhe të përgjegjshme.

Një nga vartësit e Hegseth e ka akuzuar Dario Amodei, drejtuesin e Anthropic, se e konsideron veten të pagabueshëm. Pagat shumë të larta dhe konkurrenca e fortë për inxhinierët më të mirë në industri do të thotë se ata mund të kalojnë lehtësisht në një kompani tjetër, apo edhe të tërhiqen nga puna, nëse nuk u pëlqen diçka që bën kompania e tyre. Anthropic është vendi ku përfundojnë zakonisht ata që shqetësohen më shumë për sigurinë e IA-së.

Në fakt, përplasja i ka dhënë një shtysë reputacionit të Anthropic për integritet. Brenda një dite nga momenti kur zemëroi Trump, Claude u bë aplikacioni falas më i shkarkuar në Amerikë në dyqanin digjital të Apple.

Personazhe të njohur si ylli i muzikës pop Katy Perry, e cila ka bindje të majta, mbështetën produktet e Anthropic në rrjetet sociale. Claude për pak kohë u bllokua, sipas Anthropic, si rezultat i rritjes së madhe të përdorimit.

Frika e Amodei për mbikëqyrjen masive tingëllon pothuajse si një argument marketingu. Ai argumenton se ligji nuk e ka ndjekur ende fuqinë e jashtëzakonshme të IA-së për të përpunuar dhe për të manipuluar të dhëna.

Teknologjia mund të shfrytëzojë rastet e kufizuara kur mbikëqyrja e amerikanëve është e ligjshme, thotë ai, dhe t’i shndërrojë ato në diçka shumë më të rrezikshme. Është njëkohësisht një kompliment për Claude dhe një shqetësim për liritë civile.

Por edhe nëse ka përfitime dytësore, shqetësimet për dëmin që mund të shkaktojë IA midis atyre që po e zhvillojnë atë janë reale dhe të përhapura. Qindra punonjës në OpenAI dhe Google kanë nënshkruar një letër publike duke u kërkuar drejtuesve të dy kompanive të mbështesin Anthropic.

Në vitin 2018, Google u detyrua të tërhiqej nga një kontratë me Pentagonin për të përdorur të mësuarin automatik për analizimin e pamjeve nga dronët pas një revolte të brendshme.

Edhe Altman ka thënë se shpallja e Anthropic si një rrezik për zinxhirin e furnizimit “është një vendim shumë i keq”. (Ai pretendon se OpenAI nxitimthi nënshkroi kontratën me Pentagonin vetëm për të qetësuar situatën.)

Privatisht, drejtuesit e IA-së shqetësohen për një “moment Çernobil”, kur teknologjia do të përfshihet në një katastrofë vdekjeprurëse ose shkatërruese. Konflikti me departamentin e mbrojtjes e rrit rrezikun: nëse ecja me kujdes dhe vendosja e kufijve në përdorimin e produktit tënd të sjell një dënim me vdekje për kompaninë nga qeveria federale, vetëm ata që veprojnë pa u shqetësuar për rreziqet do të mbijetojnë. Edhe tregjet krijojnë presion të padobishëm: investitorët janë të shqetësuar për kompanitë e IA-së që djegin para për të bërë investime gjigante.

Skenarët që i mbajnë zgjuar natën drejtuesit e IA-së nuk janë më vetëm hipotetikë. “Disa nga këto rreziqe tashmë po materializohen, me dëme të dokumentuara”, përfundon një raport i fundit mbi rreziqet e IA-së. Ai përmend sigurinë kibernetike dhe armët biologjike si fusha ku ndikimi i rrezikshëm i IA-së tashmë është i dukshëm.

Në shkurt Gambit Security, një kompani izraelite, raportoi se një sasi e madhe dokumentesh të ndjeshme që lidhen me taksapagues, votues dhe nëpunës civilë ishte vjedhur nga qeveria meksikane.

Edhe pse identiteti i hakerave mbetet i panjohur, është e qartë se Claude ishte një bashkëpunëtor i pavullnetshëm. Kriminelët e mashtruan duke e bërë të besonte se po merrte pjesë në një test të ligjshëm sigurie të serverëve të synuar. Ai gjeti dhe shfrytëzoi dobësi, krijoi hyrje të fshehta dhe analizoi të dhëna për të ndihmuar në fitimin e aksesit më të gjerë në sistemet qeveritare.

Zakonisht hakerat përdorin Claude dhe modele të tjera si ndihmës, për të zgjidhur probleme specifike programimi ndërsa shkruajnë malware (softuer i dëmshëm), për shembull, ose për të përpiluar mesazhe shantazhi.

Ekipi kundër-hakerave i Anthropic ka përmendur rastin e një koreanoveriori që paraqitej si një punonjës në distancë nga Perëndimi dhe që e pyeti chatbot-in se çfarë donte të thoshte një punonjës që ai po përpiqej ta mashtronte, kur ky i tha: “Bëmë piknikun e parë të sezonit”. Por disa sulme të fundit kibernetike e kanë shfrytëzuar IA-në më plotësisht.

Në nëntor Anthropic përshkroi se si hakera kinezë të mbështetur nga shteti çaktivizuan mekanizmat e sigurisë që pengojnë Claude të shkruajë malware, një proces i njohur si “jailbreaking”. Më pas i kërkuan të analizonte se si të depërtonin në rrjetet e synuara. Brenda një ore, ai po ekzekutonte softuer të ri për të shfrytëzuar dobësitë e tyre. Modele të tjera janë gjithashtu hakera të talentuar (shih grafikun).

Edhe nëse specialistët e sigurisë kibernetike përdorin IA për të gjetur dhe për të rregulluar dobësitë, do të ketë ende shumë sisteme që funksionojnë me softuer të vjetruar. IA po bëhet gjithashtu më e mirë në “inxhinierinë sociale”: taktikën e depërtimit në sisteme të sigurta duke bindur përdoruesit të dorëzojnë fjalëkalimet. Që në vitin 2024, modelet e IA-së ishin po aq të afta sa ekspertët njerëzorë për të hartuar email-e që i nxisin përdoruesit të klikojnë në faqe të rrezikshme, sipas një studimi nga Harvard Kennedy School.

Një tjetër fushë ku IA po bën hapa shqetësues është zhvillimi i armëve biologjike dhe kimike, të cilat, sipas një paralajmërimi të OpenAI në gusht, krijojnë “një rritje të ndjeshme të gjasave dhe frekuencës së ngjarjeve terroriste biologjike ose kimike”.

Kompanitë që prodhojnë ADN sipas porosisë kanë qenë prej kohësh në gjendje të kontrollojnë kërkesat e klientëve kundrejt databazave të gjeneve të rrezikshme, duke e bërë të vështirë, për shembull, krijimin e një bakteri të modifikuar gjenetikisht për të prodhuar ricinë, një neurotoksinë.

Por në tetor, në një studim të botuar në Science, studiues nga Microsoft dhe IBBIS, një organizatë ndërkombëtare për biosigurinë, vunë në dukje se përmirësimet në projektimin e proteinave me IA e bëjnë të mundur krijimin e gjeneve që prodhojnë një toksinë të ngjashme, por që nuk kanë asnjë ADN të përbashkët me gjenin origjinal. Kërkesat për të blerë sekuenca të tilla të ridizajnuara nga IA nuk do të zbuloheshin nga sistemet ekzistuese të verifikimit, megjithëse studiuesit propozuan edhe një zgjidhje.

Anthropic, Google dhe OpenAI, të cilat janë të gjitha të shqetësuara për biosigurinë, kanë zhvilluar mekanizma mbrojtës për të parandaluar keqpërdorimin e sistemeve të tyre. Por kufizimet nuk janë të përsosura.

Në mes të shkurtit, Instituti Britanik për Sigurinë e IA-së (AISI) publikoi një studim mbi një teknikë “jailbreak universal” që kishte arritur të hapte sistemet si të Anthropic ashtu edhe të OpenAI. AISI, në mënyrë të parashikueshme, kishte përdorur vetë IA për të ndihmuar në këtë proces.

Përdorimi i IA-së për të punuar mbi IA-në është një tjetër burim shqetësimi, pasi e bën më të vështirë për njerëzit të kuptojnë se çfarë po ndodh. Në shkurt, Anthropic pranoi se i përdor modelet e veta në këtë mënyrë aq shumë sa mund të mos e vërejë nëse ato fillojnë të devijojnë nga ajo që duhet të bëjnë ose nëse nisin të ndërtojnë versione të ardhshme që janë më pak të gatshme të ndjekin udhëzimet njerëzore.

Një “sabotim” i tillë është bërë më i mundshëm që kur modelet më të fundit të kompanisë kanë filluar të shfaqin “vetëdije situacionale”: kur vendosen në një skenar të sajuar për të parë nëse do të zbatojnë udhëzime për, të themi, të fshirë veten, ato shpjegojnë se e kuptojnë që udhëzimet ndoshta janë një test. Edhe pse Anthropic ka publikuar një raport mbi sabotimin që përfundon se rreziku është shumë i ulët, të tjerë nuk bien dakord.

“Po garojmë drejt mbylljes së një cikli që e dimë se është jashtëzakonisht i vështirë, nëse jo i pamundur, për t’u kontrolluar dhe për t’u siguruar që në projektim”, thotë Cyrus Hodes, bashkëthemelues i AI Safety Connect, një institut kërkimor. “Dhe njerëzit që po e mbyllin atë cikël po kërkojnë ndihmë.”

Megjithatë, ndërsa rreziqet e zhvillimit të IA-së po intensifikohen, presioni për t’i minimizuar ato po zbehet. Laboratorët kinezë nuk kanë treguar kurrë shumë shqetësim për sigurinë e IA-së. Kur DeepSeek R1 u prezantua me shumë bujë rreth një vit më parë, artikulli shoqërues nuk përmendte fare shqetësime për sigurinë.

U desh pothuajse një vit që kompania të publikonte një version të rishikuar të raportit që përfshinte një shtojcë prej 11 faqesh mbi sigurinë. Por ajo u përqendrua kryesisht në përpjekjet e DeepSeek për të parandaluar që modeli të thonte gjëra fyese ose shqetësuese.

mi për IA-në ishte tepër i përqendruar te rreziku. Në vitin 2023 Rishi Sunak, kryeministri i atëhershëm i Britanisë, organizoi një Samit Global për Sigurinë e IA-së për të diskutuar problemin.

Ai event u shndërrua fillimisht në një Samit “Veprimi” në Paris dhe më pas, muajin e kaluar, në një Samit “Ndikimi” në Delhi. “Mundësitë e IA-së, jo rreziqet e saj, po drejtojnë shumë vendime politike”, ka paralajmëruar Amodei. “Kjo lëkundje është për të ardhur keq, sepse vetë teknologjia nuk interesohet për atë që është në modë dhe ne jemi dukshëm më afër rrezikut real në vitin 2026 sesa ishim në vitin 2023.”

Organizatat që merren me sigurinë e IA-së, përfshirë institucione të mbështetura nga shteti si AISI dhe organizata të pavarura si METR, me bazë në Kaliforni, vazhdojnë të monitorojnë sistemet dhe të sinjalizojnë rreziqet.

Por këto grupe mbikëqyrëse nuk duket se kanë shumë ndikim mbi politikat. “Kemi kaluar kaq shumë vija të kuqe”, thotë Nicolas Miailhe, bashkëthemelues i AI Safety Connect, që organizon takime mbi këtë temë. “Mbani mend testin e Turing? Çfarë ndodhi me të? Ne e kemi kaluar prej kohësh. Mbani mend vijat e kuqe për sistemet autonome vdekjeprurëse? Ato po përdoren në Ukrainë nga të dyja palët. Vijat e kuqe vazhdojnë të zhvendosen.”

Në samitin e Delhit, qeveria indiane arriti të sigurojë një marrëveshje nga kompanitë më të mëdha të IA-së vetëm për të monitoruar zhvillimin e teknologjisë për rreziqe, jo për ta kufizuar atë në ndonjë mënyrë. Edhe më domethënës ishte momenti në fund të aktivitetit, kur Narendra Modi rreshtoi një listë të figurave më të njohura të industrisë së IA-së dhe i nxiti të kapnin duart me njëri-tjetrin.

Mund të kishte qenë një sinjal qetësues për botën se industria është e aftë për bashkëpunim të arsyeshëm, nëse Altman dhe Amodei, që qëndronin pranë njëri-tjetrit në skenë, nuk do të kishin refuzuar të merrnin pjesë./monitor.al